🧩로봇 물체 조작을 위한 전 세계 로봇핸드 센서 연구개발 동향

남세광, University of Bristol, 2023년도 작성

요약문

전 세계의 많은 연구 그룹에서 인간 손가락의 센싱 체계를 파악하고 그 기능을 모방한 촉각 센서를 제시하고 있으며, 이것을 로봇핸드에 적용하여 자연스러운 물체 조작의 가능성을 보여주고 있다. 그러나 여전히 산업계에서는 석션컵이나 단순 그리퍼를 활용하여 물체 조작을 하는 상황이며, 그것을 봤을 때 시장을 지배하는 촉각 센서는 아직 나오지 않았다고 봐도 무방하다. 본 보고서에서는 현재 가장 널리 쓰이는 세 가지 대표적인 촉각 센서의 원리, 장점, 그리고 단점을 요약하였으며, 미래에 촉각 센서가 산업에 파급력을 더하기 위해서는 어떠한 부분이 보완되어야 하는지 간략하게 짚어보았다.

Keyword: 로봇, 촉각 센서, 물체 조작 (Robot, Tactile sensor, Object manipulation)

1. 서론: 로봇핸드용 촉각 센서의 역사

인류는 외부로부터 들어온 정보를 처리하기 위해서 오감(시각, 청각, 후각, 미각, 촉각)을 활용하며 살아왔고, 과학기술은 이러한 다섯 가지 감각을 대표하는 기술 표현을 정의하고, 그 기술을 재생산할 수 있는 기계를 발전시켜왔다. 예를 들어, 여러 사람이 미팅하는 경우를 생각해보자. 소리의 다양한 진동 주파수를 표현해주는 스피커가 달린 전화기의 발명으로, 직접 만나지 않아도 수화기를 통하여 원격 미팅이 가능해졌다. 색 정보를 받아들이는 이미지센서의 발전과 그것을 표현해주는 모니터의 발전으로 얼굴을 보는 원격 미팅으로 발전할 수 있었다.

청각과 시각 기술의 오랜 역사에 비해, 촉각 기술은 최근 들어서 더 주목받는 젊은 학문이다. 촉각 기술의 개발이 늦어진 가장 큰 이유는 복잡한 센싱 메커니즘 때문이다. 사람 손가락의 경우 손가락 끝에 촘촘히 분포한 mechanoreceptor 라는 센싱 소자들이 접촉 정보를 생성하고 그 정보를 인간이 학습하여 압력, 전단력, 물체의 질감 등을 빠르게 처리한다고 알려져 있다. 따라서 mechanoreceptor를 재현할 수 있는 촉각 센서가 필요한데, 문제는 현재의 센서 기술이 mechanoreceptor 가 측정할 수 있는 능력을 따라가지 못하며, 심지어 센서의 크기도 작고 촘촘하게 만들기 어렵다는 데 있다.

로봇핸드에 붙일 수 있는 촉각 센서는 소자의 물리적 변형에 의한 전기적 특성을 측정하는 형태가 많았다. 가장 대표적인 제품으로는 SynTouch 사의 BioTac 센서이다. 2008년에 처음으로 개발되었고 접촉되는 물체의 힘, 압력, 온도, 질감을 전기신호로 변환하여 측정하는 형태이다. 그러나 측정 소자를 로봇 손가락 표면에 물리적으로 배치해야 하는 어려움 때문에 측정 해상도(Resolution)를 높이는 데 한계가 있었으며, 이 문제는 로봇 손가락 안쪽에 소형 카메라를 달아 해결하고자 하는 움직임으로 발전되었다. 이듬해인 2009년에 영국 Bristol 대학교 그룹이 카메라 기반의 촉각 센서를 발표하였고, 그것은 TacTip 이라는 제품으로 이어졌다며, 그 후 2017년 미국 MIT 그룹에서 카메라와 삼원색 빛을 활용하여 정교한 접촉 상태 측정이 가능한 GelSight를 개발하였다1.

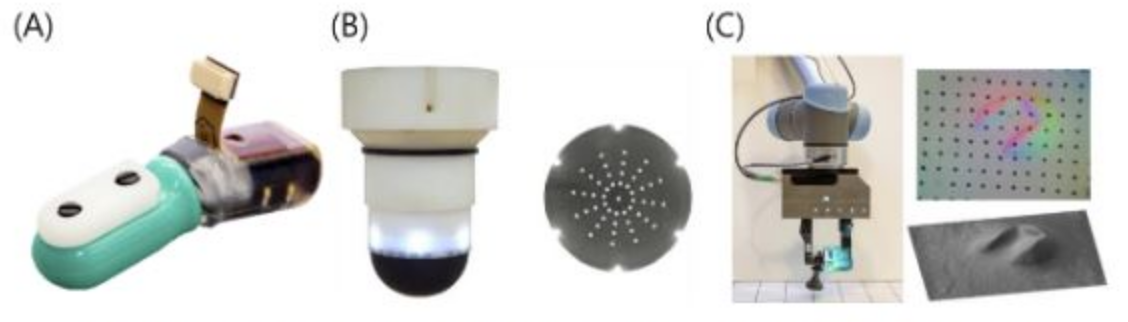

그림 1은 기 언급된 센서들의 특징을 나타내고 있다.

그림 1. 대표적인 로봇용 촉각 센서들: (A) SynTouch사의 BioTac, (B) Bristol 대학교의 TacTір, (C) MIT의 GelSight (그림 출처: 2)

본 보고서에서는 로봇핸드 또는 로봇 그리퍼의 물체 조작을 위한 대표적인 촉각 센서 세 가지를 소개하며, 각각의 장단점에 관하여 서술하고자 한다. 마지막으로 촉각 센서가 로봇의 자연스러운 물체 조작을 위해서 해결해야 할 과제 또한 소개하고자 한다.

2. 주요 촉각 센서

2.1. BioTac

BioTac 은 카메라 기반의 센서들이 나오기 전까지 가장 신뢰도가 높으며 정확한 측정이 가능한 센서였다. 사람의 손가락은 대략적인 물체의 단단함을 감지하는 압력 측정과 물체의 질감을 느끼기 위한 미세 진동 측정이 가능한 데 반해, 이와 비슷한 기능을 모두 갖는 촉각 센서의 개발은 생각보다 쉽지 않은 편이었다. 그러나 BioTac 센서는 그 두 가지 기능을 가질 뿐만 아니라 온도 변화 감지 기능까지 있어 로봇핸드 연구자로부터 많은 주목을 받았다. 특히 본 센서의 미세 진동 측정기는 1040Hz 까지 높은 진동 주파수를 잴 수 있으므로, 사람의 mechanoreceptor 가 측정할 수 있는 최대 진동 주파수인 1000Hz를 만족한다. 게다가 오랜 연구 기간을 거쳐서 출시한 제품으로 모듈화가 잘되어 있어 전문가가 아니더라도 기능을 쉽게 익힐 수 있다는 장점 또한 있다.

그러나 손가락 끝의 형상 변화를 전기적 신호로 변화하는 복잡한 구조인 만큼 그것에 따른 단점도 존재한다. 가장 대표적인 단점은 낮은 측정 해상도이다. 사람은 손가락의 넓은 영역을 골고루 이용하는 특징이 있는 만큼, 촉각 센서의 센싱 소자가 작으면 작을수록 정확한 상태 예측이 가능하다. 그러나 BioTac 은 19개의 측정 소자로 압력을 측정하는데, 측정 영역(즉, 로봇 손가락)의 부분적인 변형을 예측하기에는 부족하다. 두 번째 문제점은 측정 소자의 단단함에 있다. 전기적인 방식으로 변형을 측정하므로 딱딱한 전극이 BioTac 의 겉껍질 부분에 배치되어야 하는데, 이로 인해 사람 손가락과 같은 특유의 물렁물렁함을 구현할 수 없다. 사람 손가락의 경우 이 물렁물렁함으로 인하여 타원형인 손가락이 물체에 접촉 시, 접촉 영역을 순식간에 증가시켜 물체와의 마찰력을 강화하는 순기능이 있다. BioTac 도 그러한 부분을 강화하고자 전극의 아래층에 유체 물질을 넣어서 물렁물렁함을 구현하였으나, 오히려 이것 때문에 센서가 고압에서 터지는 사고가 종종 생긴다. 제품의 비싼 단가를 생각하면 치명적이다.

2.2. TacTip

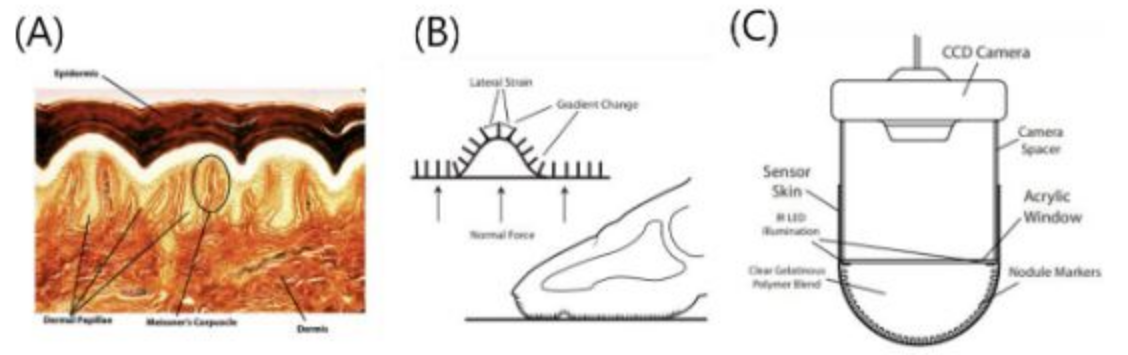

영국의 브리스톨대학교에서 개발한 TacTip 은 물체와 닿는 센서의 표면을 부드러운 재료로 만들고 그 안쪽에 돌기 형태의 마커를 심어 마커들의 움직임을 카메라로 측정하여 센서 표면의 형상 변화를 예측한다. 센서의 접촉 영역에서는 어떠한 딱딱한 부품이 없으므로 센서의 물렁물렁함을 쉽게 구현할 수 있다는 장점이 있다. 그림 2의 예시처럼 대표적인 mechanoreceptor 인 마이스너 소체(Meissner’s Corpuscle)의 위치와 작동 원리를 모방한 직관적인 센싱 메커니즘이어서 센서의 제작이나 개량에 용이하다. 실제로 본 센서는 많은 연구자가 쓸 수 있도록 지식재산권 없이 오픈소스화되어 있다3.

그림 2. (A) 대표적인 mechanoreceptor인 마이스너 소체의 생김새와 위치, (B) 마이스너 소체를 모방한 마커의 움직임 예시, (C) TacTip의 단면 이미지 (이미지 출처: 4)

TacTip 의 가장 큰 장점은 센서의 형상 변화를 그대로 촬영할 수 있다는 점이다. 특히, BioTac 이나 다른 전기신호 기반의 센서로는 측정하기 까다로운 전단력 측정이 손쉽게 가능하다. 겉 표면 안쪽에 골고루 분포한 돌기(마커)들은 겉 표면의 형상 변화에 따라서 움직이는 특성을 보이고 있으므로 센서 안쪽에 위치한 카메라가 찍은 마커의 움직임이 형상 변화를 대변하게 된다. 일반적으로 카메라가 마커의 움직임을 정확히 인식할 수 있도록 마커의 끝을 밝은 색으로 칠하고, 추가로 마커를 비추는 조명도 필요하다.

이것의 대표적인 단점은 미세 진동 측정의 어려움이다. 센서의 물렁물렁함을 구현하기 위하여 접촉 표면과 그림 2(C)의 Acrylic Window 사이에 투명한 탄성체(Elastomer)를 주입하게 되는데, 그 탄성체의 damping 성분이 마커의 미세한 진동을 방해하여 큰 움직임만 허용하게 된다. 연구 결과에 의하면 대략 60Hz 정도까지는 측정이 가능하다고는 하나, 1000Hz 정도인 사람 손가락의 능력치와 비교하기에는 부족한 수치이다. 따라서 본 센서는 접촉 물체의 질감 판별 용도로는 적합하지 않다. 그럼에도 불구하고 현재 대부분의 로봇핸드가 질감 판별보다는 접촉 물체의 형상 판별이나 전단력, 그리고 압력 측정을 통한 물체 조작 연구에 집중되어 있으므로 본 센서와 같은 형태의 측정 방식으로도 활용 가치는 충분하다.

2.3. GelSight

GelSight 도 TacTip과 마찬가지로 카메라를 활용하여 접촉된 표면의 형상 변화를 예측한다는 점에선 비슷하지만, 결정적인 차이점은 표면의 형상 변화를 측정하기 위하여 마커의 이동이 아닌 광원의 산란 형태를 활용한다는 것이다. 구체적으로, 센서 내부의 카메라 주변에 적색, 녹색, 청색(RGB) 광원을 카메라 주변에 각각 균등하게 배치하고 광원들이 센서의 접촉면을 비추도록 한다(구체적인 구조를 보기 위해서는 5의 Figure 2를 참고바란다). 센서의 접촉면은 탄성체로 구성하고 가장 바깥쪽에는 불투명한 물질을 발라 그 표면이 형상 변화가 일어났을 때 빛의 산란이 잘 일어나도록 한다. 빛의 산란은 마치 그림자가 지듯이 만들어지는데, RGB 광원이 각자 다른 각도에서 비추고 있으므로 결과적으로 적색 그림자, 녹색 그림자, 그리고 청색 그림자가 서로 조금씩 이동(Shift)하여 만들어지게 된다. 그림자의 이동량은 센서의 눌린 깊이에 비례하여 증가하게 되므로, 그림자의 모양, 그리고 각도별 이동량을 측정하여 접촉 형상을 역추적하게 된다.

이 센서의 가장 큰 장점은 물체의 접촉 표면을 높은 해상도로 재현할 수 있다는 것이다. TacTip 과 비교하여 설명하면, TacTip은 마커의 이동을 기반으로 접촉 형태를 재현하므로 해상도가 마커의 개수에 한정되어 있으나, GelSight 는 마커 대신에 불투명한 산란층의 형상 변화를 카메라가 그대로 받아들이게 되므로 카메라의 해상도에 가깝다고 볼 수 있다. 따라서 작은 물체의 측정이나 미세한 패턴을 가지는 물체의 표면 측정에 유리하다.

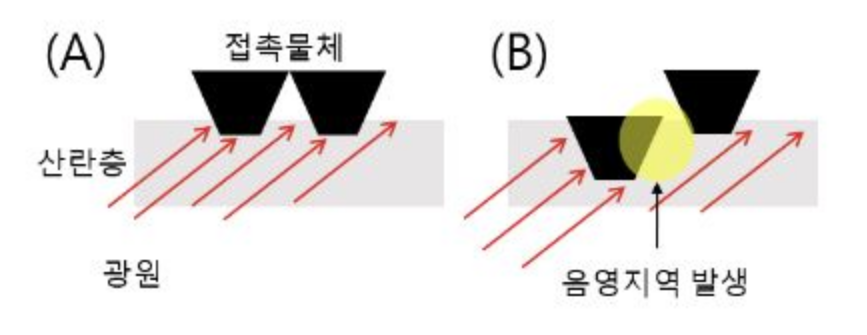

그러나 이 센서도 단점은 존재한다. 먼저, 미세 패턴 측정의 용이함에 반해 굴곡이 큰 물체의 측정에는 한계가 있다. 그림 3과 같이 물체와 접촉이 얕은 경우는 문제가 없지만, 깊은 접촉의 경우 광원의 각도에 따라서는 음영영역이 발생할 수 있다. 이런 문제는 접촉 물체의 재현 정확도를 낮추게 된다. 따라서 본 센서의 측정 부분은 평평하게 만들어지며 미세 패턴의 재현에 더 큰 목적을 가지게 된다. 그러나 인간의 손가락 형태에서 쉽게 알 수 있듯이, 로봇 손가락이 둥글게 생김으로써 조작성의 향상을 꾀할 수 있기 때문에 TacTip의 형태와 GelSight의 형상 측정 원리를 혼합한 DigiTac 이라는 하이브리드 센서도 소개되고 있다.

그림 3. (A) 얕은 접촉의 경우 측정에 문제없으나, (B) 깊은 접촉의 경우 음영영역이 발생한다.

3. 미래 기술 개발 방향

3.1. 측정 속도의 향상

TacTip 과 GelSight 에서 알 수 있듯이, 카메라의 소형화와 정보처리 속도의 향상으로 로봇핸드용 센서도 카메라를 활용하는 것이 대세가 되었다. 카메라를 활용함으로써 측정된 데이터의 해상도는 좋아졌으나 측정 속도는 여전히 과제로 남아 있다. 현재 로봇핸드에 넣을 수 있는 일반적인 소형 카메라의 촬영 속도(Frame rate per second: FPS)는 60Hz 수준이지만, 향후 인간의 손가락의 조작 능력에 비견할 정도의 센싱 능력을 갖추려면 측정 속도가 1000Hz 까지 올라와야 한다. 현재, FPS 가 높은 고성능 카메라로 물체와의 접촉을 간접 촬영한 데이터를 활용하여, 높은 측정 속도가 해결할 수 있는 물체 조작 문제가 어떤 것이 있는지 확인하는 연구 그룹이 있다. 그러나 사람의 손가락을 주로 연구하는 햅틱스(Haptics) 분야의 연구 결과를 비추어볼 때, FPS 가 높은 센서의 개발은 자명하고 필연적이다. 최근 뉴로모픽(Neuromorphic) 분야의 발전에 힘입어, 카메라의 이미지센서가 받아들이는 대량의 데이터를 마치 뉴런이 처리하듯이 단순화시켜 센싱 속도를 올리고자 하는 움직임이 있으나 어디까지나 비전 기술에 한정된 연구이며, 로봇핸드의 촉각 센서를 위한 뉴로모픽 연구는 극초기 단계에 있다.

3.2. 촉각 센서의 빠른 시뮬레이션

인공지능 시대가 성숙함에 따라서, 로봇에도 인공지능 기술이 많이 활용되게 되었다. 대표적인 예로 로봇이 강화학습을 통하여 특정 일을 수행하게 하는 것이다. 촉각 센서 연구자로서, 강화학습을 할 때, 로봇핸드의 촉각 센서가 얻은 데이터를 기반으로 로봇 팔이 그에 맞춰 움직여 특정 일을 수행하는 것이 성공적인 물체 조작 결과를 가져올 것이라고 생각하지만, 아쉽게도 촉각 센서를 강화학습에 활용하기에는 촉각 센서를 대체하는 빠른 시뮬레이션 모델이 거의 없다는 것이 문제다. 강화학습은 로봇이 반복적으로 작업을 수행하여 목적을 달성하기 위해서 스스로 학습하는 것이 핵심이다. 문제는 작업의 반복이 꽤 많기 때문에, 로봇 연구자들은 컴퓨터에 가상공간을 만들고 그 안에 가상 로봇을 만들어 가상환경에서 작업을 반복시키고, 그 결과값을 실제 환경에서 적용하는 형태로 취하고 있다. 따라서 시뮬레이션의 빠른 계산이 필요한데, 촉각 센서의 시뮬레이션은 다른 로봇의 시뮬레이션에 비해서 상당히 느리다는 것이 문제이다. 앞에서 언급한 대로 대부분의 촉각 센서들이 물체와의 접촉에 의한 물리적 변형 상태를 측정한다. 이 변형을 시뮬레이션하기 위해서는 일반적으로 유한요소법(Finite Element Method)을 사용하지만, 이것은 대량의 계산을 요구한다. 계산 결과의 정확도를 어느 정도 보장하면서도 결과값을 빠르게 낼 수 있는 촉각 센서용 시뮬레이션 모델의 개발이 시급하다.

4. 결론: 촉각 센서는 로봇의 미래

“보스턴 다이내믹스”라는 대표적인 로봇 회사가 있다. 불과 1,2년 전만 해도 그 회사의 홍보용 영상에 나오는 로봇은 실제 로봇의 움직임이 아니라 컴퓨터그래픽스 기술에 의하여 만들어진 가짜 로봇이었으나, 최근에 올라온 영상들은 로봇이 사람과 같은 움직임을 보인다. 그런데 이런 대표적인 로봇 기업조차 로봇의 손가락은 단순한 그리퍼로 되어 있다. 그것으로 물체를 조작한다기보다는 단순하게 큰 힘으로 단단하고 딱딱한 물체를 잡거나, 그리퍼를 고리로 쓰면서 가방을 들어 올리는 수준에 불과하다. 그러나 그리퍼 대신에 세밀한 물체 조작이 가능한 로봇핸드가 있다고 상상해보자. 그러면 이 로봇은 사실상 사람이 할 수 있는 대부분의 작업이 가능해질 것이다. 세상 대부분의 물건이 사람이 조작하기 쉽게 만들어졌으므로, 진정한 Human-Robot Interaction 이 가능해질 것이다. 그것을 가능하게 하는 것의 출발점이 촉각 센서가 아닐까?

참고문헌

Footnotes

Wenzhen Yuan, Siyuan Dong, and Edward H. Adelson. GelSight: High-Resolution Robot Tactile Sensors for Estimating Geometry and Force (Sensors: MDPI, 2017).↩︎

TacTip (Bristol Robotics Laboratory: Soft robotics toolkit, 2009). https://softroboticstoolkit.com/tactip↩︎

Craig Chorley, Chris Melhuish, Tony Pipe, and Jonathan Rossiter. Development of a tactile sensor based on biologically inspired edge encoding (ICRA: IEEE, 2009).↩︎

Wenzhen Yuan, Siyuan Dong, and Edward H. Adelson. GelSight: High-Resolution Robot Tactile Sensors for Estimating Geometry and Force (Sensors: MDPI, 2017).↩︎